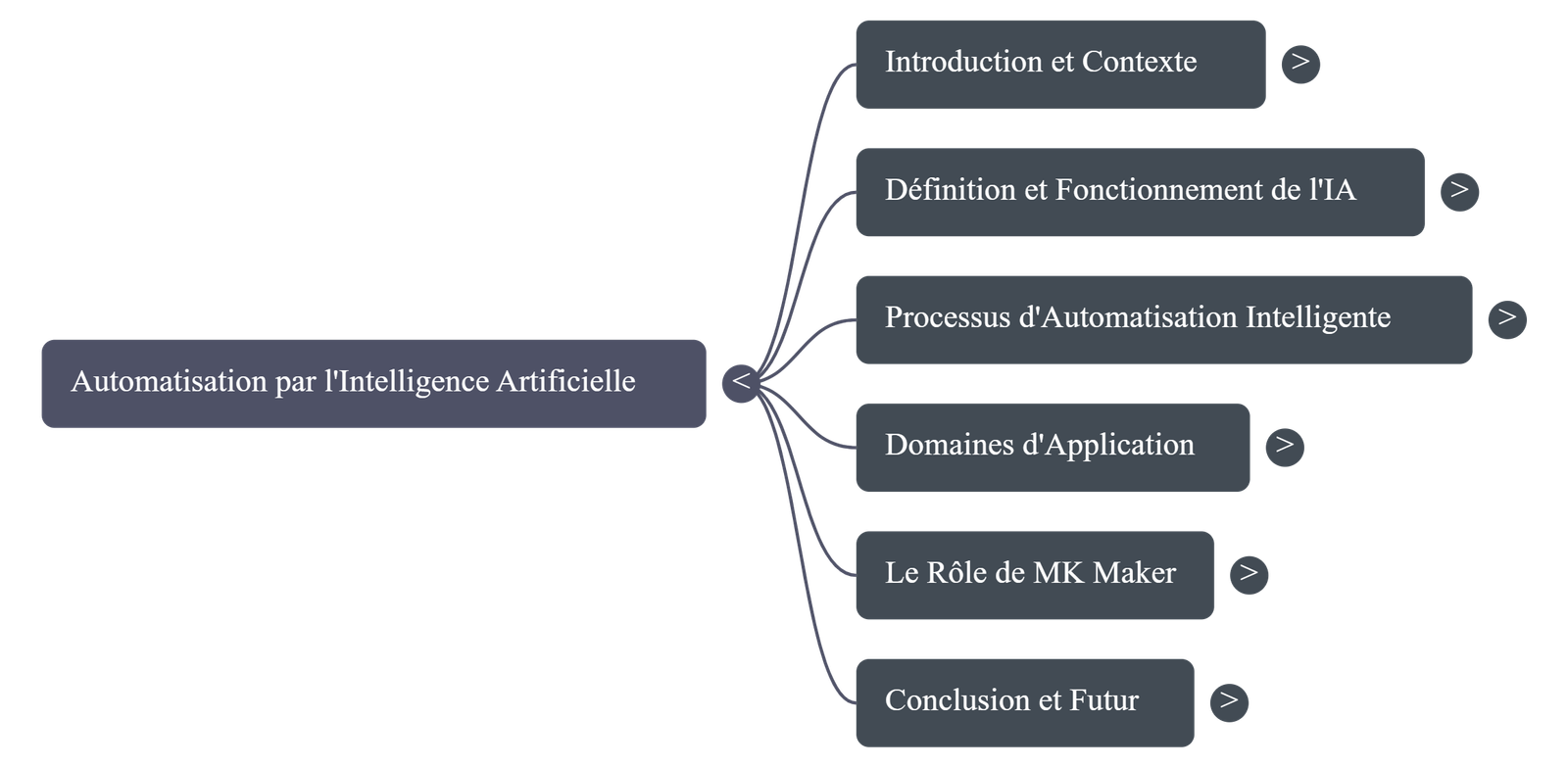

L’IA générative n’est plus une curiosité. Elle devient la matière première de nouvelles fonctions produit — de la personnalisation automatique du contenu à des copilotes qui assistent la vente ou la création technique. Mais pour créer de la valeur réelle, il faut arrêter de penser « chatbot » et commencer à penser « fonctionnalité contextualisée ».

Pourquoi l’intégration produit change la donne

Un chatbot répond à des questions. Une fonctionnalité IA intégrée agit dans le flux : elle réécrit une offre commerciale adaptée à un client, prépare un rapport réglementaire conforme aux règles internes, ou génère un prototype visuel pour un pitch. La clé, ce sont les données et le contexte : sans accès sécurisé aux documents, historiques et règles métiers, l’IA ne peut pas délivrer une valeur fiable.

Approches techniques efficaces

Deux patterns reviennent dans les implémentations réussies :

- Retrieval-Augmented Generation (RAG) : l’IA interroge une base de connaissances (documents, fiches produit, tickets) avant de générer, ce qui limite les erreurs factuelles et donne des réponses traçables.

- Données synthétiques : utile pour entraîner ou tester des flux sans exposer la donnée réelle, et pour simuler cas rares.

Ces patterns s’accompagnent toujours d’un découplage entre logique métier et modèle, afin de pouvoir changer de fournisseur ou de modèle sans refondre l’applicatif.

Gouvernance et risques à maîtriser

Les risques sont concrets : hallucinations, biais, propriété intellectuelle et conformité. Pour les gérer, il faut intégrer des garde-fous techniques et organisationnels : validation humaine sur les sorties sensibles, journaux de génération (qui a demandé quoi, quelles sources), tests adverses et métriques d’exactitude en continu.

Méthode simple pour lancer un pilote

- Choisir un cas à forte valeur mesurable (ex. génération d’offres, résumé de documents).

- Lister et sécuriser les sources de données nécessaires.

- Prototyper en RAG ou via API externe, limiter l’accès à un groupe pilote.

- Mesurer : précision factuelle, temps gagné, taux d’adoption par les utilisateurs.

- Industrialiser si les KPIs sont atteints : monitoring, politiques de sécurité, plan de montée en charge.

Organisation humaine

Pendant la phase d’apprentissage, garde un “human-in-the-loop” pour décider des corrections et pour alimenter des jeux de données curés qui amélioreront le modèle. Prends en compte les coûts cachés : hébergement des vecteurs, coût API, maintenance des pipelines.

En résumé

L’IA générative créée valeur lorsqu’elle est contextualisée, gouvernée et mesurée. Une intégration prudente et centrée produit — plutôt qu’un simple chatbot — permet de réduire les risques et d’offrir des expériences réellement utiles. Si tu veux, je peux transformer cet article en mise en page WordPress (Hn, meta tags déjà fournis) ou le traduire/adapter pour un public technique ou business.

2 — L’intégration des intelligences Artificielles

Utilise ces prompts avec ton LLM ou ton copilote interne.

- Résumé contextuel (RAG-friendly)

« À partir des documents listés ci-dessous (fiches produit, FAQ, contrat client), génère un résumé de 3 paragraphes expliquant les risques et bénéfices pour le client {nom_client}. Indique pour chaque affirmation la référence document source. » - Proposition commerciale personnalisée

« Sur la base de l’historique de {nom_client} et du template d’offre ci-dessous, rédige une proposition commerciale de 1 page mettant en avant 3 bénéfices mesurables et une estimation de coût. Indique les hypothèses chiffrées. » - Réécriture conforme

« Réécris ce texte pour qu’il respecte la clause de conformité suivante : {clause}. Garde la tonalité professionnelle, réduis le texte à 200 mots et souligne les passages modifiés. » - Génération d’exemples de tests

« Génère 10 scénarios de test adverses pour vérifier que l’IA ne révèle pas d’informations sensibles lorsqu’on lui donne un prompt contenant des données client. Pour chaque scénario, indique le résultat attendu (pass/fail). » - Prompt pour feedback humain

« Présente les 5 variantes de sortie (A–E) avec un score de confiance et une courte justification. Pose deux questions claires à l’utilisateur pilote pour recueillir son choix et sa raison. »

3 — Architecture RAG simple (texte exploitable par un dev)

Composants :

- Source de documents sécurisée (S3/SharePoint/DB)

- Pipeline d’ingestion : extraction → nettoyage → vectorisation (faiss, Milvus, Pinecone)

- Index de vecteurs + métadonnées

- Service RAG : retrieval → concaténation contexte → LLM (API interne ou fournisseur)

- Cache / découpage de prompts

- Logging & audit (requests, réponses, sources)

- Interface utilisateur (widget web / API interne)

- Module H-in-the-loop (queue de validation humaine)

- Monitoring (latence, taux d’erreur, score de précision)

Flux simplifié : Document source → ingestion → vector store

Utilisateur → requête → retrieval (top k) → concaténation contexte → LLM → réponse → si risque élevé → file H-in-the-loop → validation → livraison → logging

4 — Checklist pilote + KPIs (prêt à appliquer)

Checklist (avant lancement)

- Cas d’usage clairement défini et KPI primaire désigné.

- Inventaire des données et vérification de la qualité.

- Mécanismes d’authentification et chiffrement des données en transit et au repos.

- Indexation des documents et tests retrieval (qualité des passages récupérés).

- Prompts versionnés et tests unitaires de prompts.

- Implémentation du logging et d’un journal de génération (metadonnées).

- Processus H-in-the-loop défini (qui valide, SLA).

- Plans de rollback et seuils d’alerte pour comportement anormal.

- Tests adverses et revue de biais initiale.

- Roadmap coût (estimation API + stockage vecteurs + infra).

KPIs à suivre

Taux d’erreur critique (ex. fuite d’information, hallucination grave).

Précision factuelle (pourcentage de réponses correctes selon validation humaine).

Taux d’escalade H-in-the-loop.

Adoption utilisateur (nombre d’utilisateurs actifs, % d’utilisation par session).

Temps moyen gagné par tâche (minutes).

Coût par requête / coût par utilisateur actif.

Leave a Reply